Артём Глазунов

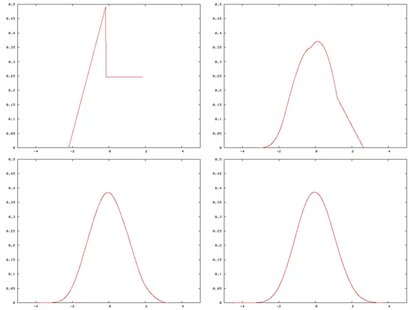

Выборочные характеристики касаются только выборки, т.е. 131 год. Они могут быть равны, а могут и не быть равны истинным значениям. Для этого мы и ищем дов интервалы, чтобы истинные оценить интервально, т.е. используя только имеющуюся у нас информацию. Другой вопрос, насколько точен подход при неизвестной дисперсии. Тут уже допущения, что выборка достаточная большая, чтобы выборочная дисперсия была близка к истинной, но это совсем не строго, нам ведь нужно в конечно итоге устаявшееся значение (в зависимости от размера выборки) дисперсии выборочного среднего. Чуть глубже: Обратите внимание на формулу для стандартизованной статистики ( при n->inf распределение сходится к N(0,1), есть в вики). В числителе сумма норм распределений минус константа, в знаменателе корень из выборочной дисперсии (распределена по хи квадрат), т.е. такая стандартизованная статистика распределена по Стьюденту с n( размер выборки) степенями свободы. Припоминаю, что уже при 30 степенях свободы распределение Стьюдента очень похоже на нормальное, так что 131 явно должно хватить для достаточно точных результатов. Здесь я не претендую на математическую строгость, чисто интуитивно))

Если в задаче из теста принять, что дисперсия относится к выборке за 131 год, то задачу не решить, потому что в задаче во втором пункте эту дисперсию просят найти )

И правильный ответ - делить то что дали в задаче на 131.

Либо я круто что то не понял.

Авторов бы спросить?

По поводу того что дисперсия выборки = дисперсия главной сл. величины.

Я так понял вы объясняете как такое может быть если выборка более 30?

Я на это узко смотрю, пусть главная случайная величина выборка за 10 000 лет наблюдения.

Тогда дисперсия за 131 год будет в 131 раз меньше, по ЦПТ