NC

Size: a a a

2020 March 12

Спасибо. Сейчас буду пробовать. Все равно других вариантов не осталось.

NC

Кстати, а могут быть какие-то конфликты драйверов nvidia и kernel? Видел на одном из форумов совет даунгрейднуть ядро.

AS

думаю проще взять нужную версию нвидиа и посмотреть с какими ядрами оно работает

FC

FC

Вот 10.0..

NC

Вот 10.0..

Проблема в том, что после установки вот этой версии у меня наглухо ломается драйвер. А с более новой ничего не работает.

FC

А на всё свежее перейти нельзя? Ядро 4, куда 10.2 и т.д...

NC

А на всё свежее перейти нельзя? Ядро 4, куда 10.2 и т.д...

Тензорфлоу не поддерживается. Ну или парень выше написал, что поддерживается, но в интернете никаких инструкций, и только топики с багами.

D

есть кто юзавший

huggingface/transformers, подскажите как завести distilgpt2?СВ

Добрый вечер

Решил поближе познакомиться с эмпирически подбираемыми параметрами нейронных сетей и у меня появились вопросы по этому поводу

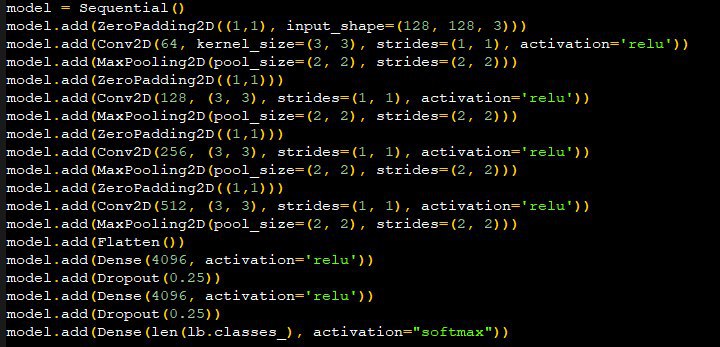

1. Какой размерности может быть скользящее окно в скрытых слоях свёрточной нейронной сети и обязательно ли оно должно быть квадратным?

2. Какие значения может принимать скорость обучения? Обычно встречал значения от 0.01 до 0.2 где-то

3. Есть ли советы по Dropout-слоям - значению, а также где и когда их стоит использовать?

Также приветствуются любая дополнительная информация об упомянутых выше сущностях))

Заранее благодарен за информацию

Решил поближе познакомиться с эмпирически подбираемыми параметрами нейронных сетей и у меня появились вопросы по этому поводу

1. Какой размерности может быть скользящее окно в скрытых слоях свёрточной нейронной сети и обязательно ли оно должно быть квадратным?

2. Какие значения может принимать скорость обучения? Обычно встречал значения от 0.01 до 0.2 где-то

3. Есть ли советы по Dropout-слоям - значению, а также где и когда их стоит использовать?

Также приветствуются любая дополнительная информация об упомянутых выше сущностях))

Заранее благодарен за информацию

И

Добрый вечер

Решил поближе познакомиться с эмпирически подбираемыми параметрами нейронных сетей и у меня появились вопросы по этому поводу

1. Какой размерности может быть скользящее окно в скрытых слоях свёрточной нейронной сети и обязательно ли оно должно быть квадратным?

2. Какие значения может принимать скорость обучения? Обычно встречал значения от 0.01 до 0.2 где-то

3. Есть ли советы по Dropout-слоям - значению, а также где и когда их стоит использовать?

Также приветствуются любая дополнительная информация об упомянутых выше сущностях))

Заранее благодарен за информацию

Решил поближе познакомиться с эмпирически подбираемыми параметрами нейронных сетей и у меня появились вопросы по этому поводу

1. Какой размерности может быть скользящее окно в скрытых слоях свёрточной нейронной сети и обязательно ли оно должно быть квадратным?

2. Какие значения может принимать скорость обучения? Обычно встречал значения от 0.01 до 0.2 где-то

3. Есть ли советы по Dropout-слоям - значению, а также где и когда их стоит использовать?

Также приветствуются любая дополнительная информация об упомянутых выше сущностях))

Заранее благодарен за информацию

Из того что пробовал:

1) Так понимаю под скользящим окном понимается ядро свертки же?

Когда пробовал кейс по восстановлению кадров из видеопотока, я использовал ядро свертки пропорциональное размерам кадра, в тестах пробовал и (16,9), и (4,3), и (5,5) , но субъективно было приятней работать с первыми двумя =)

2) Скорость обучения тоже подбирается индивидуально, я обычно адаптивную ставлю от 0.2 и ниже, а если модель на финальной стадии то 0.02 и по уменьшению. Скорость может быть в пределах от 0 до 1, но 0 и больше 0.7 не вижу оснований использовать.

3) Дропауты, пока что, добавлял только к моделям с полносвязными слоями и в задачах классификации по другому пока руки не дошли попробовать

1) Так понимаю под скользящим окном понимается ядро свертки же?

Когда пробовал кейс по восстановлению кадров из видеопотока, я использовал ядро свертки пропорциональное размерам кадра, в тестах пробовал и (16,9), и (4,3), и (5,5) , но субъективно было приятней работать с первыми двумя =)

2) Скорость обучения тоже подбирается индивидуально, я обычно адаптивную ставлю от 0.2 и ниже, а если модель на финальной стадии то 0.02 и по уменьшению. Скорость может быть в пределах от 0 до 1, но 0 и больше 0.7 не вижу оснований использовать.

3) Дропауты, пока что, добавлял только к моделям с полносвязными слоями и в задачах классификации по другому пока руки не дошли попробовать

СВ

Илья

Из того что пробовал:

1) Так понимаю под скользящим окном понимается ядро свертки же?

Когда пробовал кейс по восстановлению кадров из видеопотока, я использовал ядро свертки пропорциональное размерам кадра, в тестах пробовал и (16,9), и (4,3), и (5,5) , но субъективно было приятней работать с первыми двумя =)

2) Скорость обучения тоже подбирается индивидуально, я обычно адаптивную ставлю от 0.2 и ниже, а если модель на финальной стадии то 0.02 и по уменьшению. Скорость может быть в пределах от 0 до 1, но 0 и больше 0.7 не вижу оснований использовать.

3) Дропауты, пока что, добавлял только к моделям с полносвязными слоями и в задачах классификации по другому пока руки не дошли попробовать

1) Так понимаю под скользящим окном понимается ядро свертки же?

Когда пробовал кейс по восстановлению кадров из видеопотока, я использовал ядро свертки пропорциональное размерам кадра, в тестах пробовал и (16,9), и (4,3), и (5,5) , но субъективно было приятней работать с первыми двумя =)

2) Скорость обучения тоже подбирается индивидуально, я обычно адаптивную ставлю от 0.2 и ниже, а если модель на финальной стадии то 0.02 и по уменьшению. Скорость может быть в пределах от 0 до 1, но 0 и больше 0.7 не вижу оснований использовать.

3) Дропауты, пока что, добавлял только к моделям с полносвязными слоями и в задачах классификации по другому пока руки не дошли попробовать

решил просто автоматизировать процесс подбора эмпирических параметров для ансамбля из мелких нейронных сетей заточенных под свой объект и сделать этот процесс хотя бы псевдо-эмпирическим. Думаю сейчас пойти в сторону генетических алгоритмов. Поэтому меня интересует скорее множество допустимых значений

СВ

Илья

Из того что пробовал:

1) Так понимаю под скользящим окном понимается ядро свертки же?

Когда пробовал кейс по восстановлению кадров из видеопотока, я использовал ядро свертки пропорциональное размерам кадра, в тестах пробовал и (16,9), и (4,3), и (5,5) , но субъективно было приятней работать с первыми двумя =)

2) Скорость обучения тоже подбирается индивидуально, я обычно адаптивную ставлю от 0.2 и ниже, а если модель на финальной стадии то 0.02 и по уменьшению. Скорость может быть в пределах от 0 до 1, но 0 и больше 0.7 не вижу оснований использовать.

3) Дропауты, пока что, добавлял только к моделям с полносвязными слоями и в задачах классификации по другому пока руки не дошли попробовать

1) Так понимаю под скользящим окном понимается ядро свертки же?

Когда пробовал кейс по восстановлению кадров из видеопотока, я использовал ядро свертки пропорциональное размерам кадра, в тестах пробовал и (16,9), и (4,3), и (5,5) , но субъективно было приятней работать с первыми двумя =)

2) Скорость обучения тоже подбирается индивидуально, я обычно адаптивную ставлю от 0.2 и ниже, а если модель на финальной стадии то 0.02 и по уменьшению. Скорость может быть в пределах от 0 до 1, но 0 и больше 0.7 не вижу оснований использовать.

3) Дропауты, пока что, добавлял только к моделям с полносвязными слоями и в задачах классификации по другому пока руки не дошли попробовать

в сверточных ведь тоже есть полносвязки, поэтому и интересует дроп

И

тогда скорость от 0.01 до 0.2 и оставь,

я просто не применял ( возможно - зря) , у меня была сначала свертка а потом развертка

я просто не применял ( возможно - зря) , у меня была сначала свертка а потом развертка

2020 March 13

NC

Меняю тактику.

Киев, надо поставить tensorflow-gpu 1.15 на ubuntu 18.04. Оплата после успешного запуска тестовой модели.

Пишите в личку свои предложения по цене.

Киев, надо поставить tensorflow-gpu 1.15 на ubuntu 18.04. Оплата после успешного запуска тестовой модели.

Пишите в личку свои предложения по цене.

FC

На убунте свет сошелся? Я плохо в теме, но чаще всего убунту чувствовала себя менее предсказуемо чем родственники RHEL, в моем случае - в серверных системах

NC

На убунте свет сошелся? Я плохо в теме, но чаще всего убунту чувствовала себя менее предсказуемо чем родственники RHEL, в моем случае - в серверных системах

Я умею пользоваться только убунтой. Гайды только на убунту.

Вообще, на тензорфлоу свет не сошёлся, но альтернативы какие-то очень странные и плохо документированные. Показывать их на презентации мне бы сильно не хотелось, но видимо придется.

Вообще, на тензорфлоу свет не сошёлся, но альтернативы какие-то очень странные и плохо документированные. Показывать их на презентации мне бы сильно не хотелось, но видимо придется.

FC

А после установки тензорафлоу, куда и питона - не все ли равно, какой линукс уровнем ниже?

NC

В принципе, никакой. Но ставить ещё один линукс ради одной задачи - извращение, имхо.

FC

Вариант с докером уже пробовал?