o

Size: a a a

2021 May 22

Спасибо большое. А сегодня было что-то интересное?

YB

Сегодня было свободное общение и знакомство со спикерами в секции NLP на 1.5 часа. Много интересного рассказала и поотвечала на вопросы Татьяна Шаврина.

YB

Секция по Interpretable ML тут: https://ods.ai/tracks/interpretable-ml-df2021

Секция NLP in industry тут: https://ods.ai/tracks/nlp-df2021

Все (или те, что уже начались) треки datafest 2021 тут:

https://ods.ai/tracks/groups/data-fest-2021

Если я правильно понял, все завтрашние доклады уже есть в записи, но те, кто придут в онлайн, смогут задать вопросы.

Секция NLP in industry тут: https://ods.ai/tracks/nlp-df2021

Все (или те, что уже начались) треки datafest 2021 тут:

https://ods.ai/tracks/groups/data-fest-2021

Если я правильно понял, все завтрашние доклады уже есть в записи, но те, кто придут в онлайн, смогут задать вопросы.

AN

спасибо, с каждым днем узнаю из чатика все больше и больше нового и полезного 😆

SP

А куда приходить? в комнату в spatial chat?

2021 May 23

YB

Да. В комнату соответствующей секции в spatial chat.

MA

Всем привет.

Как определить ‘какой уровень препроцессинга’ надо произвести для нлп задачи?

Стоит задача sentiment classification, общее количество training дата около 10к, unbalanced, провёл back translation и увеличил количество в два раза.

Пример даты:

До preprocessing

Когда 10 лет назад я принял ее из приюта, она была напугана и агрессивной. Сегодня она самая любящая кошка, я когда-либо встречал.

Провёл все возможные tokenizing, lemma, stemma, stopwords итп и на выходе получил такой текст

После

принять приют напугать агрессивный самый любящий кошка когда-либо встречать.

Допустим если хочу использовать logistic regression, разумно ли делать такой preprocessing или лучше ограничиться минимумом типа удаление English words, возможно немножко stopwords итп.

Как определить ‘какой уровень препроцессинга’ надо произвести для нлп задачи?

Стоит задача sentiment classification, общее количество training дата около 10к, unbalanced, провёл back translation и увеличил количество в два раза.

Пример даты:

До preprocessing

Когда 10 лет назад я принял ее из приюта, она была напугана и агрессивной. Сегодня она самая любящая кошка, я когда-либо встречал.

Провёл все возможные tokenizing, lemma, stemma, stopwords итп и на выходе получил такой текст

После

принять приют напугать агрессивный самый любящий кошка когда-либо встречать.

Допустим если хочу использовать logistic regression, разумно ли делать такой preprocessing или лучше ограничиться минимумом типа удаление English words, возможно немножко stopwords итп.

SP

Спасибо

D

Подскажите мануалы как rubert под задачу мультилэйбл классификации приготовить.

SМ

Тф торч?

D

E

если на входе sparse matrix, то есть смысл уменьшать размер матрицы, например, удалять стоп-слова, делать лемматизацию, ограничивать количество features, выбирая самые значимые, и так далее. Было бы хорошо, если бы вы сами попробовали разные методы препроцессинга и посмотрели, как они влияют на результат.

KL

всем привет, а кто в теме Golos от Сбера, это можно как-то без хитростей использовать для распознавания речи, или это просто датасет, и надо свою модель на нем учить? Я что-то не совсем уловил )))

YB

( вообще, тебе в https://t.me/speech_recognition_ru )

1) да, golos -- это датасет, но ещё:

2) они выпустили натренированную модель на Jasper для этого датасета

3) они до конца 2021 года бесплатно дают доступ к своей облачной модели.

1) да, golos -- это датасет, но ещё:

2) они выпустили натренированную модель на Jasper для этого датасета

3) они до конца 2021 года бесплатно дают доступ к своей облачной модели.

KL

спасибо!

d

Возможно, такой препроцессинг ухудшит качество сентимент анализа

2021 May 24

MA

А какой вы посоветуете?

MA

AW

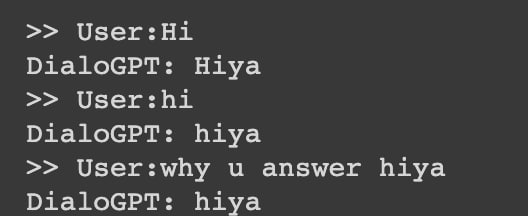

Всем привет, сижу ковыряю dialog gpt, а как сделать так чтобы на два последовательных одинаковых инпута она по разному отвечала? temperature крутил - не помогает

$